Apakah Data Latihan dalam Pembelajaran Mesin:

Definisi, Faedah, Cabaran, Contoh & Set Data

Panduan Pembeli Terunggul 2023

Pengenalan

Dalam dunia kecerdasan buatan dan pembelajaran mesin, latihan data tidak dapat dielakkan. Ini adalah proses yang menjadikan modul pembelajaran mesin tepat, cekap dan berfungsi sepenuhnya. Dalam catatan ini, kami meneroka secara terperinci apa data latihan AI, kualiti data latihan, pengumpulan & pelesenan data dan banyak lagi.

Dianggarkan bahawa rata-rata orang dewasa membuat keputusan mengenai kehidupan dan perkara sehari-hari berdasarkan pembelajaran masa lalu. Ini, seterusnya, berasal dari pengalaman hidup yang dibentuk oleh situasi dan orang. Dalam pengertian harfiah, situasi, kejadian, dan orang lain hanyalah data yang masuk ke dalam fikiran kita. Ketika kita mengumpulkan data bertahun-tahun dalam bentuk pengalaman, akal manusia cenderung membuat keputusan yang lancar.

Apa yang disampaikan ini? Data itu tidak dapat dielakkan dalam pembelajaran.

Sama seperti bagaimana seorang anak memerlukan label yang disebut abjad untuk memahami huruf A, B, C, D mesin juga perlu memahami data yang diterimanya.

Begitulah sebenarnya Kecerdasan Buatan (AI) latihan adalah mengenai. Mesin tidak berbeza dengan kanak-kanak yang belum belajar perkara dari apa yang hendak diajar. Mesin itu tidak tahu membezakan antara kucing dan anjing atau bas dan kereta kerana mereka belum mengalami barang-barang tersebut atau diajar seperti apa rupa mereka.

Jadi, bagi seseorang yang membuat kereta memandu sendiri, fungsi utama yang perlu ditambahkan adalah kemampuan sistem untuk memahami semua elemen sehari-hari yang mungkin dihadapi oleh kereta, sehingga kenderaan dapat mengenalinya dan membuat keputusan memandu yang sesuai. Di sinilah dimana Data latihan AI datang bermain.

Hari ini, modul kecerdasan buatan menawarkan banyak kemudahan dalam bentuk enjin cadangan, navigasi, automasi, dan banyak lagi. Semua itu berlaku kerana latihan data AI yang digunakan untuk melatih algoritma semasa mereka dibina.

Data latihan AI adalah proses asas dalam membina pembelajaran mesin dan algoritma AI. Sekiranya anda mengembangkan aplikasi yang berdasarkan konsep teknologi ini, anda perlu melatih sistem anda untuk memahami elemen data untuk pemprosesan yang dioptimumkan. Tanpa latihan, model AI anda tidak cekap, cacat dan berpotensi tidak berguna.

Dianggarkan bahawa Saintis Data membelanjakan lebih daripada 80% masa mereka dalam Penyediaan & Pengayaan Data untuk melatih model ML.

Oleh itu, bagi anda yang ingin mendapatkan dana daripada kapitalis teroka, para solopreneur di luar sana yang mengusahakan projek bercita-cita tinggi, dan peminat teknologi yang baru sahaja memulakan dengan AI canggih, kami telah membangunkan panduan ini untuk membantu menjawab soalan paling penting mengenai data latihan AI anda.

Di sini kita akan meneroka apa itu data latihan AI, mengapa tidak dapat dielakkan dalam proses anda, jumlah dan kualiti data yang sebenarnya anda perlukan, dan banyak lagi.

Apakah Data Latihan AI?

Data latihan AI disusun rapi dan dibersihkan maklumat yang dimasukkan ke dalam sistem untuk tujuan latihan. Proses ini membuat atau memecahkan kejayaan model AI. Ia boleh membantu dalam membangunkan pemahaman bahawa bukan semua haiwan berkaki empat dalam imej adalah anjing atau ia boleh membantu model membezakan antara jeritan marah dan ketawa gembira. Ia merupakan peringkat pertama dalam membina modul kecerdasan buatan yang memerlukan data penyusuan sudu untuk mengajar mesin asas dan membolehkan mereka belajar apabila lebih banyak data disalurkan. Ini, sekali lagi, memberi laluan kepada modul yang cekap yang menghasilkan hasil yang tepat kepada pengguna akhir.

Pertimbangkan proses data latihan AI sebagai sesi latihan untuk seorang pemuzik, di mana lebih banyak mereka berlatih, lebih baik mereka mendapat lagu atau skala. Satu-satunya perbezaan di sini ialah mesin perlu juga terlebih dahulu diajar apa itu alat muzik. Sama seperti pemuzik yang memanfaatkan masa yang tidak terkira banyaknya untuk berlatih di atas pentas, model AI menawarkan pengalaman optimum kepada pengguna apabila digunakan.

Mengapa Data Latihan AI Diperlukan?

Jawapan paling mudah mengapa data latihan AI diperlukan untuk pengembangan model adalah tanpanya mesin tidak akan tahu apa yang harus difahami sejak awal. Seperti individu yang dilatih untuk pekerjaan tertentu, mesin memerlukan kumpulan maklumat untuk memenuhi tujuan tertentu dan juga memberikan hasil yang sesuai.

Mari kita pertimbangkan lagi contoh kereta autonomi. Terabyte setelah terabyte data dalam kenderaan memandu sendiri berasal dari pelbagai sensor, peranti penglihatan komputer, RADAR, LIDAR dan banyak lagi. Semua sekumpulan besar data ini akan menjadi sia-sia sekiranya sistem pemprosesan pusat kereta tidak tahu apa yang harus dilakukan dengannya.

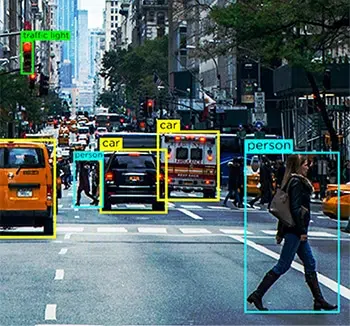

Sebagai contoh, penglihatan komputer unit kereta boleh memancarkan banyak data mengenai elemen jalan raya seperti pejalan kaki, haiwan, jalan berlubang dan banyak lagi. Sekiranya modul pembelajaran mesin tidak dilatih untuk mengenalinya, kenderaan tidak akan mengetahui bahawa itu adalah halangan yang boleh menyebabkan kemalangan jika dihadapi. Itulah sebabnya modul harus dilatih mengenai setiap elemen di jalan dan bagaimana keputusan memandu yang berbeza diperlukan untuk setiap elemen tersebut.

Walaupun ini hanya untuk elemen visual, kereta juga harus dapat memahami petunjuk manusia melalui Pemprosesan Bahasa Asli (NLP) and koleksi audio atau ucapan dan bertindak balas dengan sewajarnya. Sebagai contoh, jika pemandu memerintahkan sistem infotainment di dalam kereta untuk mencari stesen minyak di sekitarnya, ia harus dapat memahami keperluan dan memberikan hasil yang sesuai. Untuk itu, bagaimanapun, harus dapat memahami setiap perkataan dalam frasa, menghubungkannya dan dapat memahami soalan.

Walaupun anda mungkin tertanya-tanya apakah proses data latihan AI hanya rumit kerana digunakan untuk kes penggunaan berat seperti kereta autonomi, hakikatnya malah filem berikutnya yang disarankan oleh Netflix melalui proses yang sama untuk memberikan cadangan yang diperibadikan kepada anda. Sebarang aplikasi, platform atau entiti yang mempunyai AI yang berkaitan dengannya secara lalai dikuasakan oleh data latihan AI.

Apakah jenis data yang saya perlukan?

Terdapat 4 jenis data utama yang diperlukan iaitu, Gambar, Video, Audio / Ucapan atau Teks untuk melatih model pembelajaran mesin dengan berkesan. Jenis data yang diperlukan akan bergantung pada berbagai faktor seperti kasus penggunaan di tangan, kerumitan model yang akan dilatih, kaedah latihan yang digunakan, dan kepelbagaian data input yang diperlukan.

Berapa banyak data yang mencukupi?

Mereka mengatakan bahawa tidak ada akhir pembelajaran dan ungkapan ini sesuai dalam spektrum data latihan AI. Semakin banyak data, semakin baik hasilnya. Walau bagaimanapun, tindak balas yang tidak jelas kerana ini tidak cukup untuk meyakinkan sesiapa sahaja yang ingin melancarkan aplikasi bertenaga AI. Tetapi kenyataannya adalah tidak ada aturan umum, formula, indeks atau pengukuran jumlah data yang tepat yang diperlukan seseorang untuk melatih kumpulan data AI mereka.

Seorang pakar pembelajaran mesin secara komik akan mendedahkan bahawa algoritma atau modul yang terpisah harus dibina untuk menyimpulkan jumlah data yang diperlukan untuk sebuah projek. Sayangnya kenyataan itu juga.

Sekarang, ada sebab mengapa sangat sukar untuk meletakkan jumlah data yang diperlukan untuk latihan AI. Ini kerana kerumitan yang terlibat dalam proses latihan itu sendiri. Modul AI terdiri daripada beberapa lapisan serpihan yang saling berkaitan dan bertindih yang mempengaruhi dan melengkapkan proses satu sama lain.

Sebagai contoh, anggap anda sedang mengembangkan aplikasi mudah untuk mengenali pokok kelapa. Dari pandangan, kedengarannya agak sederhana, bukan? Namun, dari perspektif AI, ia jauh lebih kompleks.

Pada mulanya, mesin kosong. Ia tidak tahu apa itu pokok terlebih dahulu apalagi pokok berbuah tropika yang tinggi dan khusus kawasan. Untuk itu, model perlu dilatih mengenai apa itu pohon, bagaimana membezakan dari benda tinggi dan langsing lain yang mungkin muncul dalam bingkai seperti lampu jalan atau tiang elektrik dan kemudian terus mengajarnya nuansa pohon kelapa. Setelah modul pembelajaran mesin mengetahui apa itu pokok kelapa, seseorang dapat dengan aman menganggapnya tahu bagaimana mengenalinya.

Tetapi hanya apabila anda memberi makan gambar pohon beringin, anda akan menyedari bahawa sistem tersebut salah mengenalpasti pokok beringin untuk pohon kelapa. Untuk sistem, apa-apa yang tinggi dengan dedaunan berkelompok adalah pokok kelapa. Untuk menghilangkannya, sistem sekarang perlu memahami setiap pokok yang bukan pokok kelapa untuk mengenal pasti dengan tepat. Sekiranya ini adalah proses untuk aplikasi sehala sederhana dengan hanya satu hasil, kita hanya dapat membayangkan kerumitan yang terlibat dalam aplikasi yang dibangunkan untuk penjagaan kesihatan, kewangan dan banyak lagi.

Selain daripada ini, apa yang mempengaruhi jumlah data yang diperlukan latihan merangkumi aspek yang disenaraikan di bawah:

- Kaedah latihan, di mana perbezaan dalam jenis data (berstruktur dan tidak berstruktur) mempengaruhi keperluan jumlah data

- Pelabelan data atau teknik anotasi

- Cara data dimasukkan ke sistem

- Hasil toleransi ralat, yang bermaksud peratusan kesilapan yang boleh diabaikan dalam ceruk atau domain anda

Contoh Dunia Nyata Volume Latihan

Walaupun jumlah data yang anda perlukan untuk melatih modul anda bergantung pada projek anda dan faktor-faktor lain yang telah kami bincangkan sebelumnya, sedikit inspirasi atau rujukan akan membantu mendapatkan idea yang luas mengenai data keperluan.

Berikut adalah contoh dunia nyata mengenai jumlah set data yang digunakan untuk tujuan latihan AI oleh pelbagai syarikat dan perniagaan.

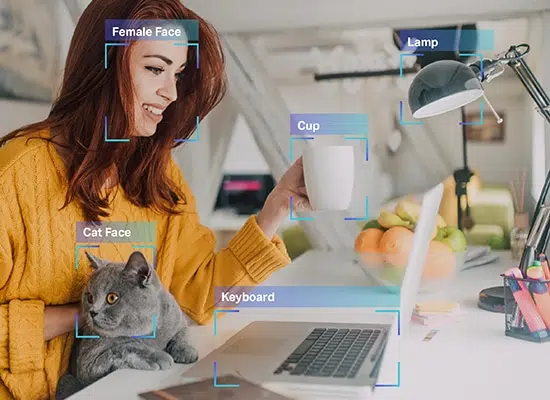

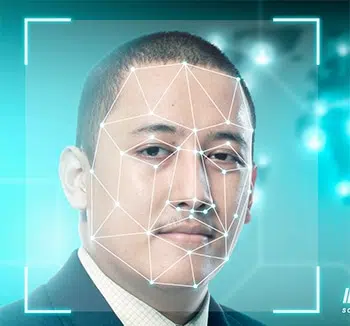

- pengecaman wajah - ukuran sampel lebih daripada 450,000 gambar wajah

- Anotasi gambar - ukuran sampel lebih daripada 185,000 gambar dengan hampir dengan 650,000 objek yang dianotasi

- Analisis sentimen Facebook - saiz sampel lebih dari 9,000 komen dan 62,000 catatan

- Latihan chatbot - ukuran sampel lebih daripada 200,000 soalan dengan lebih 2 juta jawapan

- Aplikasi terjemahan - ukuran sampel lebih dari 300,000 audio atau ucapan koleksi dari penutur bukan asli

Bagaimana jika saya tidak mempunyai data yang mencukupi?

Dalam dunia AI & ML, latihan data tidak dapat dielakkan. Betul dikatakan bahawa tidak ada akhir belajar perkara baru dan ini berlaku apabila kita membincangkan spektrum data latihan AI. Semakin banyak data, semakin baik hasilnya. Namun, ada keadaan di mana kes penggunaan yang ingin Anda selesaikan berkaitan dengan kategori khusus, dan sumber data yang tepat itu adalah satu cabaran. Jadi dalam senario ini, jika anda tidak mempunyai data yang mencukupi, ramalan dari model ML mungkin tidak tepat atau mungkin berat sebelah. Terdapat beberapa cara seperti peningkatan data dan penambahan data yang dapat membantu anda mengatasi kekurangan namun hasilnya mungkin masih tidak tepat atau boleh dipercayai.

Bagaimana anda meningkatkan Kualiti Data?

Kualiti data berkadar langsung dengan kualiti output. Itulah sebabnya model yang sangat tepat memerlukan set data berkualiti tinggi untuk latihan. Namun, ada tangkapan. Untuk konsep yang bergantung pada ketepatan dan ketepatan, konsep kualiti sering kali agak kabur.

Data berkualiti tinggi terdengar kuat dan boleh dipercayai tetapi apa sebenarnya maksudnya?

Apa kualiti di tempat pertama?

Seperti data yang kita masukkan ke dalam sistem kita, kualiti juga mempunyai banyak faktor dan parameter yang berkaitan dengannya. Sekiranya anda menghubungi pakar AI atau veteran pembelajaran mesin, mereka mungkin akan berkongsi apa-apa permasalahan data berkualiti tinggi -

- Seragam - data yang bersumber dari satu sumber tertentu atau keseragaman dalam set data yang bersumber dari pelbagai sumber

- Komprehensif - data yang merangkumi semua senario yang mungkin diusahakan oleh sistem anda

- Konsisten - setiap bait data serupa

- melaporkan - data yang anda sumber dan umpan serupa dengan keperluan anda dan hasil yang diharapkan dan

- pelbagai - anda mempunyai gabungan semua jenis data seperti audio, video, gambar, teks dan banyak lagi

Sekarang setelah kita memahami apa arti kualiti dalam kualiti data, mari kita dengan cepat melihat berbagai cara untuk memastikan kualiti pengumpulan data dan generasi.

1. Perhatikan data berstruktur dan tidak berstruktur. Yang pertama mudah difahami oleh mesin kerana mereka mempunyai elemen dan metadata yang diberi penjelasan. Yang terakhir, bagaimanapun, masih mentah tanpa maklumat berharga yang dapat digunakan oleh sistem. Di sinilah penjelasan data masuk.

2. Menghilangkan bias adalah cara lain untuk memastikan data berkualiti kerana sistem menghilangkan segala prasangka dari sistem dan memberikan hasil yang objektif. Bias hanya membatalkan keputusan anda dan menjadikannya sia-sia.

3. Bersihkan data secara meluas kerana ini akan sentiasa meningkatkan kualiti output anda. Mana-mana saintis data akan memberitahu anda bahawa sebahagian besar peranan tugas mereka adalah membersihkan data. Apabila anda membersihkan data anda, anda akan membuang pendua, kebisingan, nilai yang hilang, kesalahan struktur dll.

Apa yang mempengaruhi kualiti data latihan?

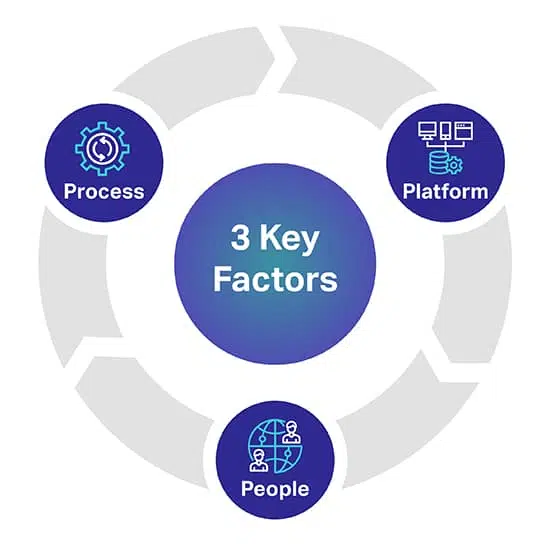

Terdapat tiga faktor utama yang dapat membantu anda meramalkan tahap kualiti yang anda inginkan untuk Model AI / ML anda. 3 faktor utama adalah Orang, Proses dan Platform yang boleh membuat atau mematahkan Projek AI anda.

Platform: Platform proprietari manusia-dalam-gelung yang lengkap diperlukan untuk mencari, mentranskripsikan dan memberi anotasi pelbagai kumpulan data untuk berjaya menerapkan inisiatif AI dan ML yang paling menuntut. Platform ini juga bertanggungjawab untuk menguruskan pekerja, dan memaksimumkan kualiti dan hasil

orang: Untuk menjadikan AI berfikir dengan lebih bijak mengambil orang yang merupakan beberapa minda paling pintar dalam industri ini. Untuk meningkatkan skala, anda memerlukan ribuan profesional ini di seluruh dunia untuk melakukan transcriber, label, dan memberi penjelasan untuk semua jenis data.

Proses: Menyampaikan data standard emas yang konsisten, lengkap, dan tepat adalah kerja yang kompleks. Tetapi itulah yang selalu anda perlukan untuk mematuhi standard kualiti tertinggi serta kawalan dan pusat pemeriksaan kualiti yang ketat dan terbukti.

Dari mana anda mendapatkan Data Latihan AI?

Tidak seperti bahagian sebelumnya, kami mempunyai pandangan yang sangat tepat di sini. Bagi anda yang mencari sumber data

atau jika anda sedang dalam proses pengumpulan video, pengumpulan gambar, pengumpulan teks dan banyak lagi, ada tiga

jalan utama dari mana anda dapat memperoleh data anda.

Mari kita menerokainya secara individu.

Sumber Percuma

Sumber percuma adalah jalan yang merupakan tempat penyimpanan data dalam jumlah besar secara sukarela. Ini adalah data yang terletak di permukaan secara percuma. Sebilangan sumber percuma termasuk -

- Set data Google, di mana lebih dari 250 juta set data dikeluarkan pada tahun 2020

- Forum seperti Reddit, Quora dan banyak lagi, yang merupakan sumber data yang berguna. Selain itu, sains data dan komuniti AI di forum ini juga dapat membantu anda dengan set data tertentu ketika menghubungi.

- Kaggle adalah sumber percuma lain di mana anda dapat mencari sumber pembelajaran mesin selain daripada set data percuma.

- Kami juga telah menyenaraikan set data terbuka percuma untuk anda memulakan latihan model AI anda

Walaupun jalan ini percuma, apa yang akan anda habiskan adalah masa dan usaha. Data dari sumber percuma ada di mana-mana dan anda harus menyediakan berjam-jam kerja untuk mendapatkan, membersihkan dan menyesuaikannya sesuai dengan keperluan anda.

Salah satu petunjuk penting lain yang perlu diingat adalah bahawa beberapa data dari sumber percuma juga tidak dapat digunakan untuk tujuan komersial. Ia memerlukan pelesenan data.

Mengikis Data

Seperti namanya, pengikisan data adalah proses melombong data dari pelbagai sumber menggunakan alat yang sesuai. Dari laman web, portal awam, profil, jurnal, dokumen dan banyak lagi, alat dapat mengikis data yang anda perlukan dan membawanya ke pangkalan data anda dengan lancar.

Walaupun ini sepertinya penyelesaian yang ideal, pengikisan data hanya sah untuk penggunaan peribadi. Sekiranya anda adalah syarikat yang ingin mengikis data dengan cita-cita komersial yang terlibat, ia menjadi rumit dan bahkan menyalahi undang-undang. Itulah sebabnya anda memerlukan pasukan undang-undang untuk memeriksa laman web, kepatuhan dan syarat sebelum anda dapat mengikis data yang anda perlukan.

Penjual Luar

Sejauh pengumpulan data untuk data latihan AI, penyumberan luar atau menjangkau vendor luar untuk set data adalah pilihan yang paling ideal. Mereka memikul tanggungjawab untuk mencari set data untuk keperluan anda sementara anda boleh fokus membina modul anda. Ini secara khusus kerana sebab-sebab berikut -

- anda tidak perlu menghabiskan berjam-jam mencari jalan data

- tidak ada usaha dari segi pembersihan data dan klasifikasi yang terlibat

- anda mendapat set data berkualiti yang tepat untuk memeriksa semua faktor yang telah kita bincangkan beberapa waktu lalu

- anda boleh mendapatkan set data yang disesuaikan dengan keperluan anda

- anda boleh meminta jumlah data yang anda perlukan untuk projek anda dan banyak lagi

- dan yang paling penting, mereka juga memastikan bahawa pengumpulan data mereka dan data itu sendiri mematuhi garis panduan peraturan tempatan.

Satu-satunya faktor yang dapat membuktikan kekurangan bergantung pada skala operasi anda ialah penyumberan luar melibatkan perbelanjaan. Sekali lagi, apa yang tidak melibatkan perbelanjaan.

Shaip sudah menjadi pemimpin dalam perkhidmatan pengumpulan data dan memiliki gudang data kesihatan dan kumpulan data pertuturan / audio sendiri yang boleh dilesenkan untuk projek AI bercita-cita tinggi anda.

Buka Dataset - Untuk menggunakan atau tidak untuk digunakan?

Sebagai contoh, terdapat set data ulasan produk Amazon yang menampilkan lebih dari 142 juta ulasan pengguna dari tahun 1996 hingga 2014. Untuk gambar, anda mempunyai sumber yang sangat baik seperti Google Open Images, di mana anda boleh mendapatkan sumber data dari lebih dari 9 juta gambar. Google juga mempunyai sayap yang disebut Machine Perception yang menawarkan hampir 2 juta klip audio yang berdurasi sepuluh saat.

Walaupun terdapat sumber-sumber ini (dan lain-lain), faktor penting yang sering diabaikan adalah keadaan yang disertakan dengan penggunaannya. Sudah pasti mereka awam tetapi ada garis tipis antara pelanggaran dan penggunaan wajar. Setiap sumber dilengkapi dengan keadaannya sendiri dan jika anda meneroka pilihan ini, kami sarankan berhati-hati. Ini kerana dengan alasan memilih jalan bebas, anda mungkin akan dikenakan tuntutan undang-undang dan perbelanjaan bersekutu.

Kos Sebenar Data Latihan AI

Hanya wang yang anda belanjakan untuk mendapatkan data atau menjana data dalaman bukanlah perkara yang perlu anda pertimbangkan. Kita mesti mempertimbangkan elemen linear seperti masa dan usaha yang dibelanjakan dalam membangunkan sistem AI dan kos dari perspektif transaksi. gagal untuk memuji yang lain.

Masa yang Dibelanjakan untuk Sumber dan Anotasi Data

Faktor seperti geografi, demografi pasaran, dan persaingan dalam niche anda menghalang ketersediaan set data yang berkaitan. Masa yang dihabiskan untuk mencari data secara manual adalah membuang masa untuk melatih sistem AI anda. Sebaik sahaja anda berjaya mendapatkan data anda, anda akan melambatkan latihan dengan meluangkan masa untuk memberi penjelasan kepada data tersebut agar mesin anda dapat memahami apa yang sedang diberi makan.

Harga Pengumpulan dan Pengiklanan Data

Perbelanjaan overhed (Pengumpul data dalaman, Anotator, Menyelenggara peralatan, Infrastruktur teknologi, Langganan alat SaaS, Pembangunan aplikasi proprietari) diperlukan untuk dikira semasa mendapatkan data AI

Kos Data Buruk

Data yang buruk boleh menyebabkan moral pasukan syarikat anda, kelebihan daya saing anda, dan akibat nyata lain yang tidak disedari. Kami mendefinisikan data buruk sebagai kumpulan data yang tidak bersih, mentah, tidak berkaitan, ketinggalan zaman, tidak tepat, atau penuh dengan kesalahan ejaan. Data yang buruk dapat merosakkan model AI anda dengan memperkenalkan bias dan merosakkan algoritma anda dengan hasil yang miring.

Perbelanjaan Pengurusan

Semua kos yang melibatkan pentadbiran organisasi atau syarikat anda, tangibles, dan intangibles merupakan perbelanjaan pengurusan yang sering kali paling mahal.

Apa seterusnya selepas Penyumberan Data?

Sebaik sahaja anda mempunyai set data di tangan anda, langkah seterusnya adalah memberi penjelasan atau labelnya. Selepas semua tugas yang rumit, apa yang anda ada adalah data mentah yang bersih. Mesin masih tidak dapat memahami data yang anda miliki kerana tidak dijelaskan. Di sinilah baki cabaran sebenar bermula.

Seperti yang kami sebutkan, mesin memerlukan data dalam format yang dapat difahami. Inilah yang dilakukan oleh anotasi data. Ia memerlukan data mentah dan menambahkan lapisan label dan tag untuk membantu modul memahami setiap elemen dalam data dengan tepat.

Sebagai contoh, dalam teks, pelabelan data akan memberitahu sistem AI sintaks tatabahasa, bahagian ucapan, preposisi, tanda baca, emosi, sentimen dan parameter lain yang terlibat dalam pemahaman mesin. Ini adalah bagaimana chatbots memahami perbualan manusia dengan lebih baik dan hanya apabila mereka melakukannya, mereka dapat meniru interaksi manusia dengan lebih baik melalui tindak balas mereka juga.

Seperti yang tidak dapat dielakkan kedengarannya, ia juga sangat memakan masa dan membosankan. Tidak kira skala perniagaan anda atau cita-citanya, masa yang diperlukan untuk menganotasi data sangat besar.

Ini terutamanya kerana tenaga kerja anda yang ada perlu meluangkan masa dari jadual harian mereka untuk memberi penjelasan kepada data sekiranya anda tidak mempunyai pakar anotasi data. Oleh itu, anda perlu memanggil ahli pasukan anda dan memberikannya sebagai tugas tambahan. Semakin lama kelewatan, semakin lama masa yang diperlukan untuk melatih model AI anda.

Walaupun ada alat percuma untuk anotasi data, itu tidak menghilangkan hakikat bahawa proses ini memakan masa.

Di situlah vendor anotasi data seperti Shaip masuk. Mereka membawa pasukan pakar anotasi data khusus untuk mereka untuk hanya menumpukan perhatian pada projek anda. Mereka menawarkan penyelesaian dengan cara yang anda mahukan untuk keperluan dan keperluan anda. Selain itu, anda dapat menetapkan jangka waktu bersama mereka dan menuntut pekerjaan yang harus diselesaikan dalam jangka waktu tertentu.

Salah satu faedah utama ialah hakikat bahawa ahli pasukan dalaman anda dapat terus memberi tumpuan kepada perkara yang lebih penting untuk operasi dan projek anda sementara pakar melakukan tugas mereka untuk memberi penjelasan dan pelabelan data untuk anda.

Dengan penyumberan luar, kualiti optimum, masa minimum dan ketepatan maksimum dapat dijamin.

Membungkus Up

Itulah semua data latihan AI. Dari memahami apa itu data latihan hingga menerokai sumber percuma dan faedah penyumberan luar penjelasan data, kami membincangkan semuanya. Sekali lagi, protokol dan dasar masih tidak stabil dalam spektrum ini dan kami selalu mengesyorkan agar anda menghubungi pakar data latihan AI seperti kami untuk keperluan anda.

Dari sumber, penghilangan identiti hingga anotasi data, kami akan membantu anda dengan semua keperluan anda sehingga anda hanya dapat membina platform anda. Kami memahami selok-belok yang terlibat dalam sumber data dan pelabelan. Itulah sebabnya kami mengulangi kenyataan bahawa anda boleh menyerahkan tugas sukar kepada kami dan memanfaatkan penyelesaian kami.

Hubungi kami untuk semua keperluan anotasi data anda hari ini.

Mari berbincang

Soalan-soalan yang kerap ditanya (FAQ)

Sekiranya anda ingin membuat sistem pintar, anda perlu memberi maklumat yang bersih, dikurasi, dan dapat ditindaklanjuti untuk memudahkan pembelajaran yang diselia. Maklumat berlabel disebut data latihan AI dan merangkumi metadata pasaran, algoritma ML, dan apa sahaja yang membantu dalam membuat keputusan.

Setiap mesin berkuasa AI mempunyai keupayaan yang dibatasi oleh kedudukan sejarahnya. Ini bermaksud mesin hanya dapat meramalkan hasil yang diinginkan jika telah dilatih sebelumnya dengan set data yang setanding. Data latihan membantu latihan yang diawasi dengan jumlah yang sebanding dengan kecekapan dan ketepatan model AI.

Set data latihan yang berbeza diperlukan untuk melatih algoritma Pembelajaran Mesin tertentu, kerana membantu penyediaan bertenaga AI mengambil keputusan penting dengan mempertimbangkan konteks. Sebagai contoh, jika anda berencana untuk menambahkan fungsi Computer Vision ke mesin, model-model tersebut perlu dilatih dengan gambar beranotasi dan lebih banyak set data pasaran. Begitu juga, untuk kehebatan NLP, pengumpulan ucapan yang banyak berfungsi sebagai data latihan.

Tidak ada had atas jumlah data latihan yang diperlukan untuk melatih model AI yang kompeten. Semakin besar jumlah data, kemampuan model untuk mengenal pasti dan memisahkan elemen, teks, dan konteks lebih baik.

Walaupun terdapat banyak data yang tersedia, tidak setiap potongan sesuai untuk model latihan. Agar algoritma berfungsi dengan sebaik mungkin, anda memerlukan set data yang komprehensif, konsisten dan relevan, yang diekstrak secara seragam tetapi masih cukup pelbagai untuk merangkumi pelbagai senario. Terlepas dari data, Anda berencana untuk menggunakan, lebih baik membersihkan dan memberi keterangan yang sama untuk pembelajaran yang lebih baik.

Sekiranya anda mengingati model AI tertentu tetapi data latihan tidak mencukupi, anda mesti terlebih dahulu membuang outliers, memasangkan persediaan pemindahan dan pembelajaran berulang, menyekat fungsi, dan membuat persediaan sebagai sumber terbuka bagi pengguna untuk terus menambahkan data untuk melatih mesin, secara berperingkat, mengikut masa. Anda juga boleh mengikuti pendekatan mengenai peningkatan data dan pemindahan pembelajaran untuk memanfaatkan set data yang terhad.

Set data terbuka selalu dapat digunakan untuk mengumpulkan data latihan. Walau bagaimanapun, jika anda mencari eksklusif untuk melatih model dengan lebih baik, anda boleh bergantung pada vendor luaran, sumber percuma seperti Reddit, Kaggle, dan banyak lagi, dan bahkan Pengikisan Data untuk melombong pandangan secara terpilih dari profil, portal, dan dokumen. Terlepas dari pendekatannya, perlu memformat, mengurangi, dan membersihkan data yang diperoleh sebelum menggunakannya.